AI Era Faculty Survival15-minute talk

Jewoong Moon · The University of Alabama

From knowledge gatekeeper to judgment designer

AI 시대

교수들의

생존법

이제 교수의 경쟁력은 많이 아는 것보다, 무엇을 믿고 무엇을 검증하며 무엇을 설계하게 할 것인지에 달려 있다.

연구자·교수 관점평가 재설계지식 습득 질서의 재편2026.05.03

AI 시대 교수들의 생존법

01

ThesisWhy now

Problem shift

한 줄 요약

교수는 더 이상

지식의 입구가 아니다.

연구자는 이미 AI와 함께 논문을 찾고, 요약하고, 코드 초안을 만들고, 문장을 다듬고, 아이디어를 시험한다. 남는 질문은 “AI를 쓸 것인가”가 아니라 “어디까지 맡기고 어디서 인간 판단이 개입해야 하는가”다.

생존의 핵심은 설명자가 아니라 판단의 설계자가 되는 것.

role shift

Knowledge gatekeeper → judgment designer

Old role

Know

희소한 지식과 접근권을 관리하는 사람

New role

Judge

질문, 과정, 증거, 책임의 구조를 설계하는 사람

입구가 아닌 설계자

02

Before AIAcademic training

Assumption stack

우리가 배웠던 정공법

연구자와 교수는

희소성과 지연의 세계에서 길러졌다

01

읽기

핵심 텍스트와 정전을 오래 읽는다

02

훈련

방법론, 인용, 설계 규범을 공동체 안에서 익힌다

03

검증

동료평가와 느린 출판으로 지식을 통과시킨다

04

전달

강의실에서 구조화된 순서로 설명한다

05

평가

산출물로 개인 이해를 간접 판정한다

희소성

논문, 데이터, 전문가 피드백에 접근하는 데 비용과 시간이 컸다.

순차성

읽기, 이해, 쓰기, 토론의 순서가 비교적 안정적이었다.

안정성

지식의 권위는 느리지만 기관과 학회가 보장했다.

예전 연구 루프는 이렇게 느렸다

문헌 찾기

도서관 DB, 키워드 조정, 참고문헌 역추적에 시간이 많이 들었다.

노트 정리

읽은 내용을 다시 요약하고 연결하며 스스로 이해를 만들었다.

초안 쓰기

문장 하나하나를 쓰는 과정 자체가 사고를 정리하는 시간이었다.

검토 받기

동료 피드백과 리뷰는 느렸지만, 그만큼 중간 점검의 의미가 컸다.

희소성과 지연의 세계

03

ShockCompressed loop

What AI changed

AI가 압축한 것

지식 습득의

중간 단계가

압축되었다

이전에는 문헌 탐색, 첫 초안, 코드 스캐폴딩, 요약, 문장 정리가 연구 훈련의 일부였다. 지금은 그 상당 부분이 몇 초 안에 외주화된다.

literature scandraftingcodingtranslationreview prep

Before

찾기, 읽기, 정리, 쓰기, 코딩, 재검토가 연구자 훈련 자체였다.

Now

탐색-요약-초안-코드 생성이 거의 동시화되면서 검증과 경계 설정이 더 중요해졌다.

압축된 학습 루프

04

CollisionsConfusions

Six tensions

지금 연구 현장이 부딪히는 것

AI와 함께 연구하는 과정은

여섯 가지 충돌을 만든다

Truth

그럴듯한 문장과 검증된 사실이 분리된다

Authorship

누가 아이디어를 냈고 누가 문장을 만들었는지 흐려진다

Methods

코드와 분석이 빨라질수록 재현성과 점검 책임이 커진다

Review

peer review까지 자동화 압력을 받으며 판단의 질이 흔들린다

Tempo

생산 속도가 읽기와 숙고의 속도를 앞질러 과부하를 만든다

Confidentiality

민감한 데이터와 초고를 어디까지 넣어도 되는지 불분명하다

tension map

truth / authorship / methods / review / tempo / confidentiality

AI는 하나의 문제를 가져온 것이 아니라, 연구실이 따로 관리하던 문헌 탐색, 초안 작성, 코드, 데이터, 심사, 공개의 문제를 한 번에 겹쳐 놓았다.

혼란의 구조

05

EvidenceResearch adoption

2023-2026

연구자는 이미 쓰고 있다. 다만 아직 안정적으로 제도화하지 못했다

연구 현장의 핵심 변수는

속도가 아니라 검증과 책임 배분이다

Van Noorden & Perkel (2023): Nature survey는 전 세계 1,600명 이상 연구자를 대상으로 AI 도구가 과학 연구에서 점점 보편화되고 있으며, 많은 연구자가 향후 핵심 인프라가 될 것으로 본다고 보고했다.

Nordling (2023): Nature의 글로벌 postdoc survey에서 약 3분의 1이 챗봇을 사용해 문장 다듬기, 코드 생성·편집, 문헌 정리를 하고 있다고 보고했다.

Besser, Jensen, & Katz (2026): 한 연구중심대학 조사에서 29%가 최소 한 개 이상의 연구 작업에 GenAI를 쓰고 있었고, 주요 용도는 text refinement, code generation, rapid information retrieval였다.

research dashboard

research workflows already shifting

29%

Besser et al. (2026): surveyed researchers using GenAI for at least one research task.

nature surveypostdoc surveyopen research europe

연구 채택은 이미 시작되었다

06

EvidenceResearch governance

Policy lag

연구 거버넌스는 아직 뒤따라간다

연구실은 이미 AI를 쓰는데,

규범과 책임 구조는 아직 느리다

AI and Ethics

30

Ganguly et al. (2025): 미국 R1 대학 30곳의 연구자용 GenAI 가이드라인을 분석했고, disclosure, privacy, attribution, external policy checking이 반복적으로 등장했다.

Onus

1

같은 연구는 규정 준수의 부담이 결국 개별 연구자에게 귀속된다고 정리했다.

UNESCO

2023

UNESCO는 인간중심 접근, 데이터 프라이버시 보호, researchers 역량 개발, coherent policy framework를 공식 권고했다.

Peer review

2025

Naddaf (2025): AI가 peer review에 빠르게 스며들고 있고, 많은 과학자가 리뷰의 신뢰성과 책임성 약화를 우려한다고 보도했다.

실천은 앞서가고 규범은 늦다

07

FutureWhat changes next

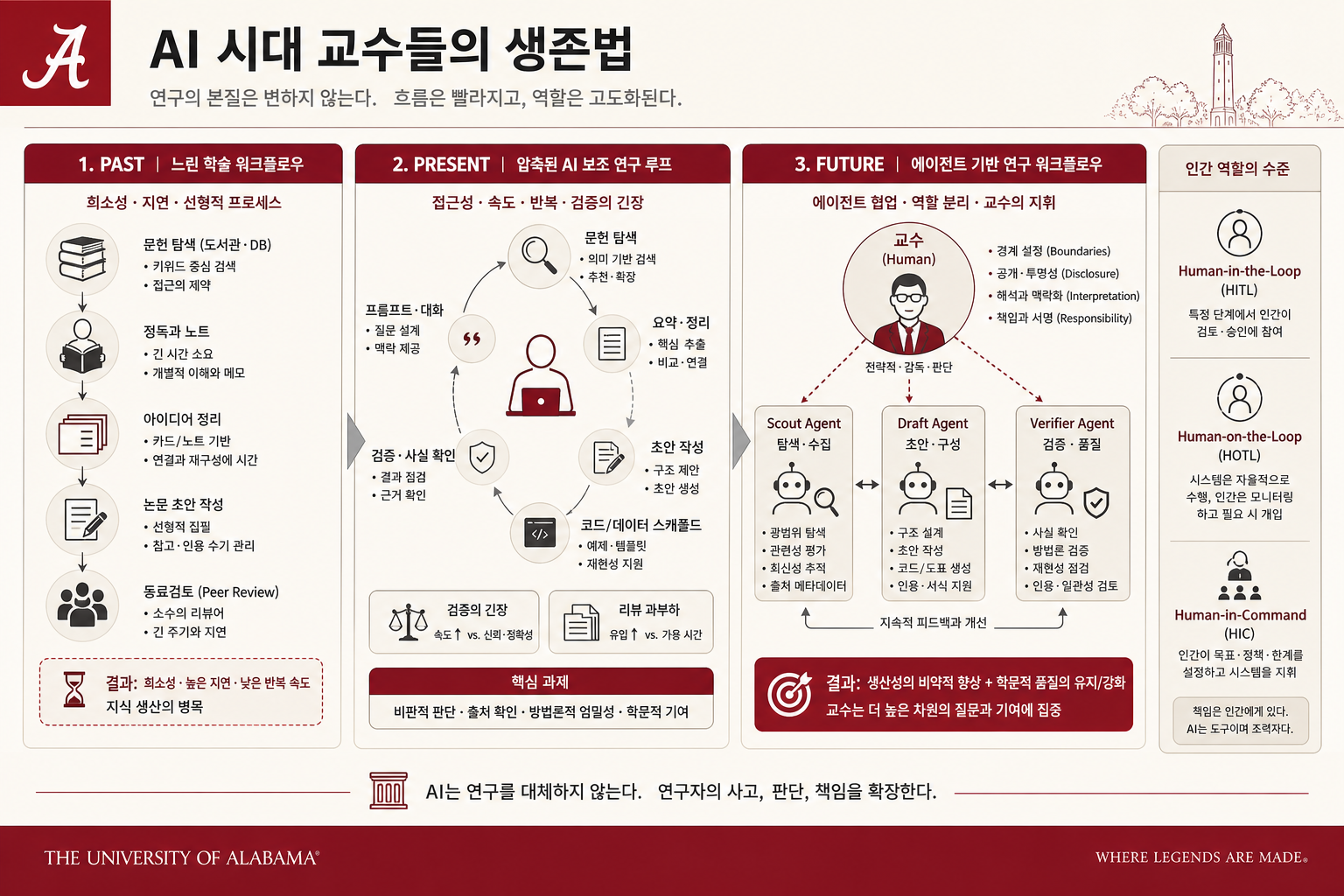

Past present future

미래는 누가 더 많이 아느냐보다 누가 더 잘 운영하느냐의 문제다

과거의 교수는 지식을 모았고,

현재의 교수는 속도와 충돌하고,

미래의 교수는 워크플로우를 설계한다

핵심 변화

이제 경쟁력은 “내가 얼마나 많이 알고 있나”보다 연구실이 어떤 규칙으로 AI를 쓰고 검증하는가에 달린다.

메시지는 단순하다. AI를 금지할지 허용할지를 두고 머물지 말고, 연구실 차원의 `허용 범위`, `검증 절차`, `공개 방식`, `최종 책임`을 문서로 정해야 한다.

Past

희소한 지식에 접근하고, 오래 읽고, 늦게 검토받는 방식이 연구자 훈련의 기본이었다.

Present

탐색, 요약, 구조 잡기, 코드 스캐폴딩이 빨라지며 생산 속도와 검증 속도의 차이가 커졌다.

Future

교수는 더 많이 아는 사람보다, 무엇을 맡기고 무엇을 끝까지 사람이 책임질지 설계하는 사람에 가까워진다.

과거 현재 미래

08

ActionWhat to change tomorrow

Lab rules

거창한 정책보다, 지금 쓰는 도구 안에 작은 습관을 심는 쪽이 더 현실적이다

내일부터 연구실에서

바꿔야 할 것은 다섯 가지다

01

두 문장 적기

README나 lab wiki에 “우리는 AI를 어디에 쓰고, 어디에는 안 쓴다” 두 문장만 적어두기

02

이슈 네 개 만들기

`scan`, `counterexample`, `method`, `verify` 네 칸으로 일을 나눠보기

03

확인 세 개 넣기

초안 공유 전 `DOI 맞나`, `인용 맞나`, `주장 과한가` 세 가지만 보기

04

랩 미팅 질문 바꾸기

“무엇을 했나”에 더해 “AI를 어디에 썼고 무엇을 다시 봤나”를 묻기

05

한 번만 시험하기

모든 프로젝트에 적용하지 말고, 한 개에서만 2주 정도 시험해보기

GitHub에서 바로 해볼 수 있는 예

예를 들어 issue를 네 개로 나눌 수 있다. `literature-scan`: 이번 주 새 논문 10개. `counterexample-check`: 내 주장에 반례 3개. `method-alternative`: 다른 분석 2개. `final-verification`: DOI, 인용, 표 숫자 다시 확인.

복잡한 시스템을 만드는 대신, 지금 쓰는 도구 안에 작은 확인 절차를 심는 쪽이 훨씬 유용하다. Notion이어도 좋고, GitHub여도 좋고, 그냥 lab notebook이어도 괜찮다.

내일부터 바꿀 다섯 가지

10

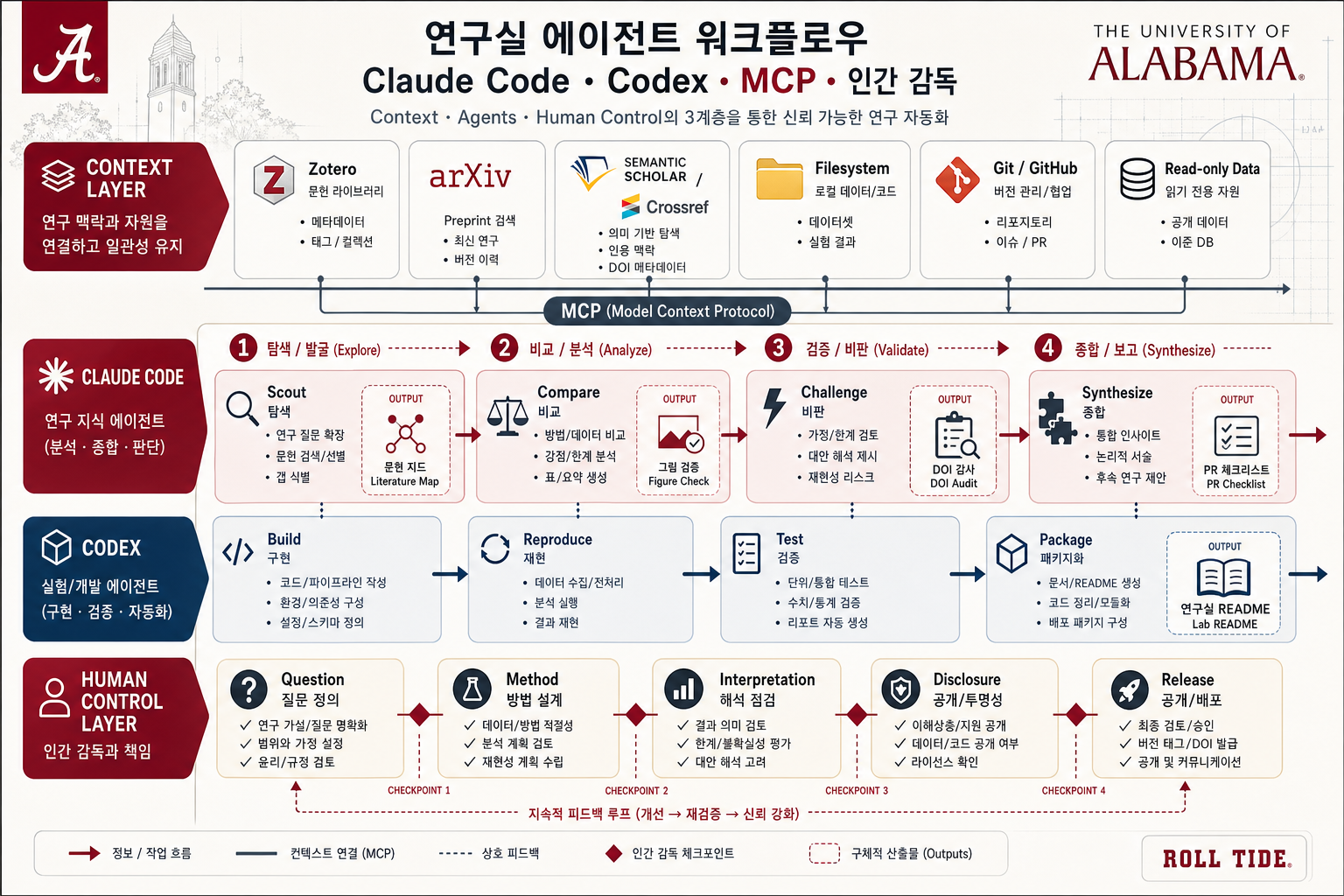

WorkflowAgentic design

Human oversight

Scout

문헌 찾기

놓친 키워드, 리뷰논문, 주변 분야를 더 가져오기

놓친 키워드, 리뷰논문, 주변 분야를 더 가져오기

Challenge

반례 찾기

내 주장에 대한 반례, 과한 일반화, 약한 연결 지적

내 주장에 대한 반례, 과한 일반화, 약한 연결 지적

Method

방법 다시 보기

다른 분석, 빠진 변수, 더 나은 설계 가능성 보기

다른 분석, 빠진 변수, 더 나은 설계 가능성 보기

Verify

공유 전 확인

DOI, 인용, 표 숫자, claim tone 다시 보기

DOI, 인용, 표 숫자, claim tone 다시 보기

바로 써먹는 구조

AI가 대신 써주는지보다, 연구자가 하던 일을 네 개의 작은 확인 흐름으로 나누는 편이 더 유용하다.

좋은 질문

“놓친 키워드 5개만 더 줘.”

좋은 반론

“이 주장에 반례 3개만.”

좋은 점검

“DOI 없는 항목만 골라줘.”

사람이 할 일

질문 선택, 해석, 최종 공개

GitHub

issue 4개 + PR 체크

랩 운영

미팅 질문 1개만 추가

제안 가능한 agentic workflow

11

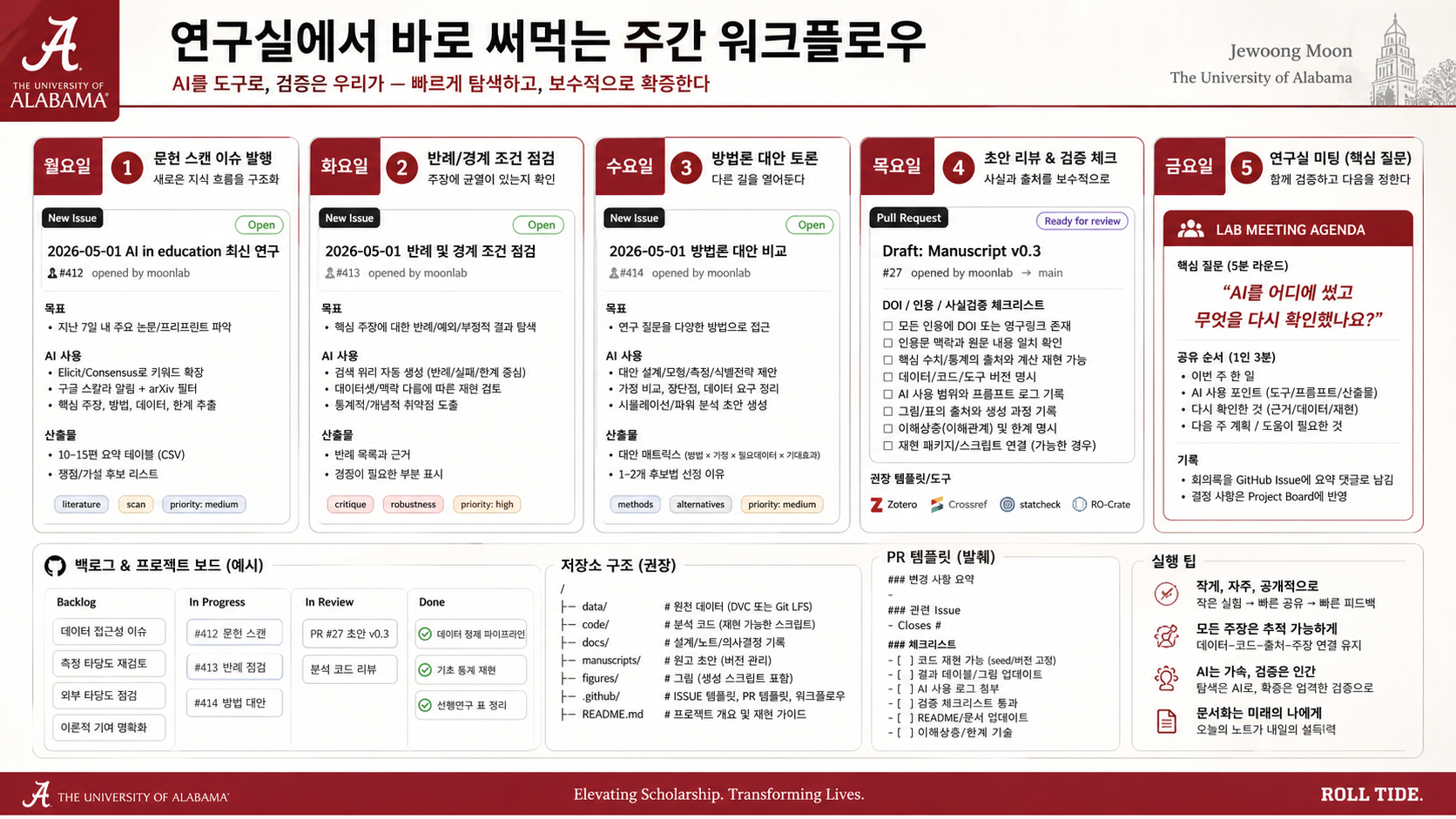

VisualWeekly lab workflow

Practical workflow

연구실 주간 워크플로우

13

Proposal30-day implementation

Concrete plan

제안

30일 안에 할 수 있는 일은

생각보다 작고, 그래서 더 현실적이다

Week 1

README나 lab wiki에 두 줄만 적는다: 어디에 쓰는지, 어디에는 안 쓰는지

Week 2

랩 미팅 질문 하나만 바꾼다: “AI를 어디에 썼고, 무엇을 다시 확인했나요?”

Week 3

초안 공유 전에 세 칸만 본다: citation, DOI, factual claim

Week 4

한 프로젝트에서만 시험한다: scout, challenge, method, verify 네 단계로

What success looks like

누가 많이 썼는지보다, 어디에 썼고 무엇을 다시 확인했는지 말할 수 있으면 충분하다.

Message

거대한 선언보다 작은 워크플로우 수정이 더 중요하다. README 두 줄, 이슈 네 개, 체크리스트 세 칸, 파일럿 하나면 시작할 수 있다.

2 README lines4 issues3 checks1 pilot

제언

14

VisualPR checklist

Draft review

연구 초안 PR 체크리스트

15

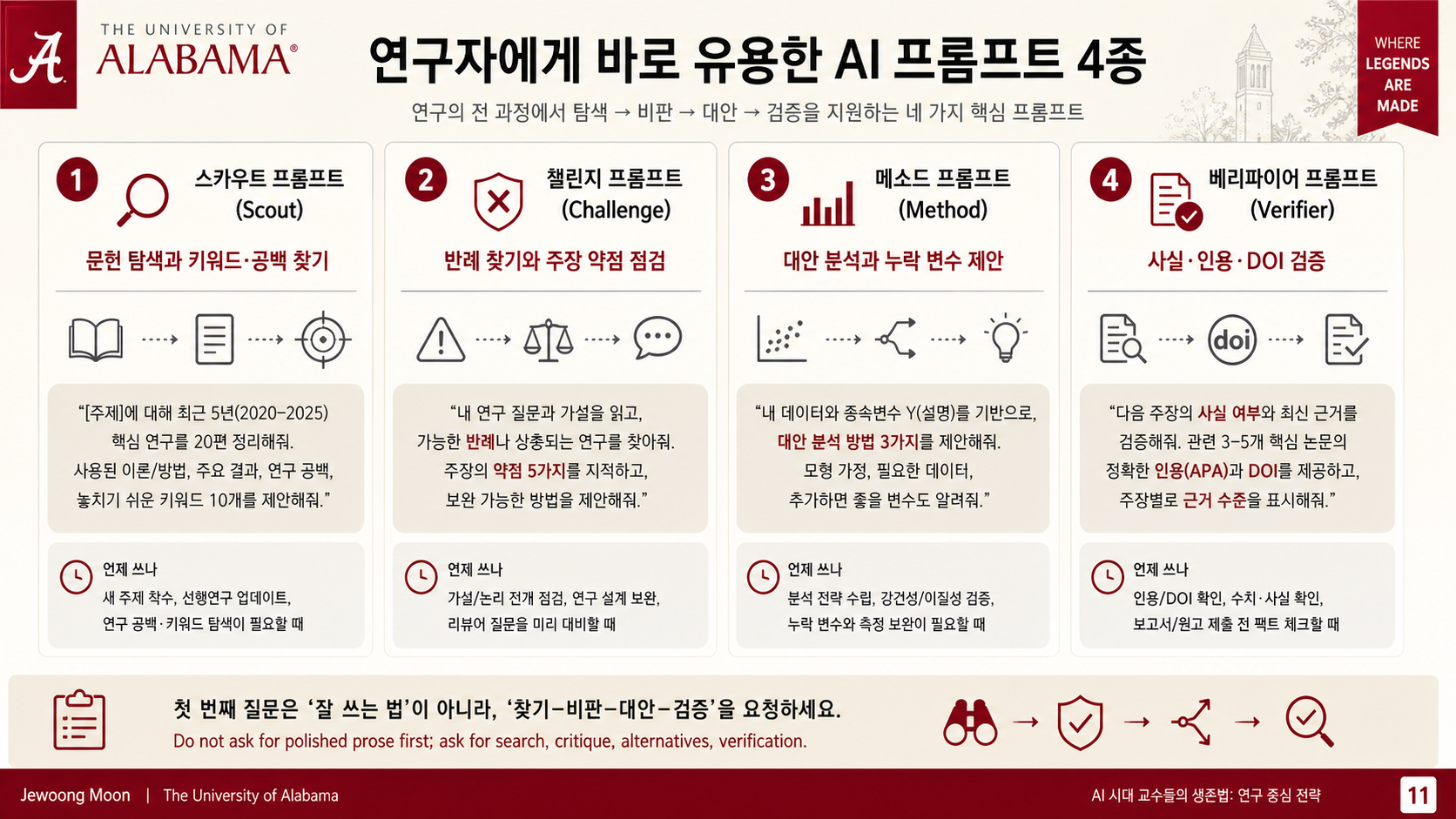

VisualAI prompts

Research use

연구자용 AI 프롬프트 4종

16

ReferencesFact-checked

Primary sources

마지막 질문

우리는 연구자에게

AI를 쓰지 말라고 말하는가,

아니면 AI를 써도 되는 경계와

검증 책임을 가르치고 있는가?

Full references

Van Noorden, R., & Perkel, J. M. (2023). AI and science: what 1,600 researchers think. Nature, 621(7980), 672-675. https://doi.org/10.1038/d41586-023-02980-0

Nordling, L. (2023). How ChatGPT is transforming the postdoc experience. Nature, 622(7983), 655-657. https://doi.org/10.1038/d41586-023-03235-8

Besser, S. A., Jensen, E. A., & Katz, D. S. (2026). How generative AI is shaping research software development and maintenance at a research-intensive university. Open Research Europe, 6, 56. https://doi.org/10.12688/openreseurope.22009.1

Ganguly, A., Johri, A., Ali, A., et al. (2025). Generative artificial intelligence for academic research: evidence from guidance issued for researchers by higher education institutions in the United States. AI and Ethics, 5, 3917-3933. https://doi.org/10.1007/s43681-025-00688-7

Nordling, L. (2023). How ChatGPT is transforming the postdoc experience. Nature, 622(7983), 655-657. https://doi.org/10.1038/d41586-023-03235-8

Besser, S. A., Jensen, E. A., & Katz, D. S. (2026). How generative AI is shaping research software development and maintenance at a research-intensive university. Open Research Europe, 6, 56. https://doi.org/10.12688/openreseurope.22009.1

Ganguly, A., Johri, A., Ali, A., et al. (2025). Generative artificial intelligence for academic research: evidence from guidance issued for researchers by higher education institutions in the United States. AI and Ethics, 5, 3917-3933. https://doi.org/10.1007/s43681-025-00688-7

UNESCO. (2023). Guidance for generative AI in education and research. UNESCO. https://unesdoc.unesco.org/ark:/48223/pf0000386693

Naddaf, M. (2025). AI is transforming peer review — and many scientists are worried. Nature, 639, 852-854. https://doi.org/10.1038/d41586-025-00894-7

Parrilla, J. M. (2023). ChatGPT use shows that the grant-application system is broken. Nature, 623, 443. https://doi.org/10.1038/d41586-023-03238-5

Desaire, H., Isom, M., & Hua, D. (2024). Almost nobody is using ChatGPT to write academic science papers (yet). Big Data and Cognitive Computing, 8(10), 133. https://doi.org/10.3390/bdcc8100133

GitHub Docs. (n.d.). About issue and pull request templates; About saved replies. https://docs.github.com/en/communities/using-templates-to-encourage-useful-issues-and-pull-requests/about-issue-and-pull-request-templates ; https://docs.github.com/en/get-started/writing-on-github/working-with-saved-replies

Naddaf, M. (2025). AI is transforming peer review — and many scientists are worried. Nature, 639, 852-854. https://doi.org/10.1038/d41586-025-00894-7

Parrilla, J. M. (2023). ChatGPT use shows that the grant-application system is broken. Nature, 623, 443. https://doi.org/10.1038/d41586-023-03238-5

Desaire, H., Isom, M., & Hua, D. (2024). Almost nobody is using ChatGPT to write academic science papers (yet). Big Data and Cognitive Computing, 8(10), 133. https://doi.org/10.3390/bdcc8100133

GitHub Docs. (n.d.). About issue and pull request templates; About saved replies. https://docs.github.com/en/communities/using-templates-to-encourage-useful-issues-and-pull-requests/about-issue-and-pull-request-templates ; https://docs.github.com/en/get-started/writing-on-github/working-with-saved-replies

Q&A

17